El Imperativo de Identificar la Inteligencia Artificial en la Creación de Contenido

La inteligencia artificial (IA) ha trascendido su papel como concepto teórico para convertirse en una fuerza omnipresente que moldea activamente el panorama digital. Su creciente capacidad para generar diversos tipos de contenido digital, que abarcan texto, imágenes, audio y video, está transformando la manera en que se produce y consume la información . La sofisticación de los modelos de IA ha alcanzado un punto en el que la distinción entre el contenido creado por humanos y el generado por máquinas se vuelve cada vez más tenue .

Esta proliferación de contenido generado por IA presenta tanto oportunidades como riesgos significativos. Por un lado, la IA ofrece la promesa de una mayor eficiencia, escalabilidad y personalización en la creación de contenido, lo que permite a individuos y empresas producir grandes volúmenes de material adaptado a necesidades específicas . Sin embargo, esta democratización de la creación de contenido también plantea serias preocupaciones sobre la autenticidad, la precisión, la propiedad intelectual, los sesgos inherentes y la propagación de información errónea .

En este contexto, surge un desafío central: la necesidad imperante de establecer mecanismos efectivos para identificar el contenido generado por IA. Esta identificación es crucial para fomentar la transparencia, mantener la confianza en la información digital y promover un uso ético de la IA en la esfera digital. Sin la capacidad de discernir el origen del contenido, los usuarios podrían consumir o compartir inadvertidamente material generado por IA, lo que podría llevar a la difusión de noticias falsas o a la erosión de la confianza en las fuentes de información .

El presente informe se propone abordar este desafío mediante un análisis exhaustivo de la necesidad de identificar el contenido generado por IA. Para ello, se explorará la evolución histórica de la IA en la creación de contenido, la proliferación actual de herramientas de IA generativa, las respuestas regulatorias a nivel global, las técnicas de marcas de agua digitales y su eficacia, las herramientas de detección de contenido de IA, las políticas de las plataformas digitales y las perspectivas de diversas industrias creativas. Finalmente, se sintetizará la información recopilada para ofrecer una conclusión elaborada sobre la importancia de las marcas de IA y las posibles direcciones futuras para una convivencia informada y ética con la inteligencia artificial en la creación de contenido.

La accesibilidad y la facilidad de uso de las herramientas de IA generativa están provocando un aumento exponencial en el volumen de contenido digital, lo que hace que la tarea de identificar el material generado por IA sea cada vez más desafiante y crítica. A medida que las herramientas de IA se vuelven más fáciles de usar, la producción de contenido digital ya no se limita a los profesionales. Este aumento en la creación de contenido, una parte significativa del cual es generado por IA, sobrepasa los mecanismos existentes para verificar la autenticidad. El gran volumen hace que la revisión manual sea imposible, y la sofisticación de la IA hace que la detección visual o auditiva no sea confiable. Esto requiere métodos automatizados y robustos para identificar el contenido de IA a gran escala.

Si bien la IA generativa democratiza la creación de contenido, también introduce un riesgo significativo de diluir el valor de la creatividad humana y potencialmente perturbar los medios de vida de artistas, escritores, músicos y otros profesionales creativos. La capacidad de la IA para generar contenido de forma rápida y a gran escala, a veces imitando el estilo de los creadores humanos, plantea preocupaciones sobre la infracción de derechos de autor y la compensación justa. Si el contenido generado por IA se vuelve ubicuo y fácilmente accesible, la demanda de trabajo creado por humanos podría disminuir, lo que generaría desafíos económicos para quienes trabajan en las industrias creativas. Esta posible devaluación del arte humano subraya la necesidad de regulaciones y directrices éticas que rijan el uso de la IA en la creación de contenido.

La Génesis y el Crecimiento de la IA en la Creación de Contenido

La trayectoria de la inteligencia artificial en la creación de contenido ha experimentado una transformación notable a lo largo de las décadas, marcada por hitos cruciales que han impulsado su capacidad para emular la creatividad humana. En sus inicios, la IA en la creación de contenido se basaba en sistemas basados en reglas (décadas de 1950 y 1960), que empleaban reglas y lógica predefinidas para generar contenido básico . Estos sistemas, aunque rudimentarios, sentaron las bases para futuros avances. Un ejemplo temprano fue ELIZA, un chatbot diseñado para simular una conversación humana mediante el reconocimiento de patrones .

La década de 1980 y 1990 presenciaron el auge del aprendizaje automático (machine learning), donde los sistemas de IA comenzaron a aprender de los datos, adaptándose y tomando decisiones más allá de las reglas rígidas . Este período vio las primeras aplicaciones de la IA en el procesamiento del lenguaje natural y la personalización de datos . Con el auge de Internet a principios de la década de 2000, la disponibilidad masiva de información proporcionó un vasto conjunto de datos para que los sistemas de IA aprendieran, lo que llevó a una IA más inteligente capaz de manejar tareas de creación de contenido más complejas, como informes básicos y artículos de noticias .

La década de 2010 estuvo definida por el aprendizaje profundo (deep learning) y las redes neuronales, inspiradas en la estructura del cerebro humano. Estos avances mejoraron significativamente la capacidad de la IA para comprender y generar texto similar al humano, crear imágenes realistas e incluso componer música . La introducción de las redes neuronales recurrentes (RNNs) y las redes de memoria a corto plazo (LSTMs) fue fundamental para el procesamiento de datos secuenciales como el lenguaje .

La era actual, que comenzó a finales de la década de 2010, está marcada por la IA generativa, con la aparición de modelos avanzados como GPT, DALL-E y Midjourney, capaces de crear contenido altamente sofisticado y creativo . El desarrollo de las redes generativas antagónicas (GANs) y la arquitectura Transformer fueron avances clave en esta etapa .

A lo largo de esta evolución, se han producido hitos y avances clave que han impulsado las capacidades de la IA en la creación de contenido. En 2010, Narrative Science introdujo Quill, un programa para la generación automatizada de narrativas a partir de datos sin procesar . Associated Press comenzó a utilizar la IA en 2014 para automatizar la información financiera y deportiva . La serie GPT de OpenAI ha tenido un impacto significativo en la generación de texto , al igual que los modelos de generación de imágenes como DALL-E y Midjourney . La IA también ha encontrado aplicaciones en la creación de audio y video .

La sofisticación de la IA en la creación de contenido ha alcanzado un punto en el que puede imitar la creatividad humana de manera cada vez más convincente, pasando de la simple automatización a la generación de contenido que puede ser casi indistinguible del trabajo humano . Las proyecciones sugieren una influencia futura significativa de la IA en la producción de contenido en diversos medios .

La evolución de la IA en la creación de contenido muestra una clara tendencia de creciente autonomía y sofisticación, pasando de sistemas basados en reglas a modelos que aprenden y generan contenido con notables cualidades similares a las humanas. La IA temprana se basaba en programación explícita. El cambio al aprendizaje automático permitió a la IA aprender patrones de los datos, lo que llevó a un contenido más flexible y matizado. El aprendizaje profundo, con sus redes neuronales, permitió a la IA procesar información compleja como el lenguaje humano y los datos visuales de manera más efectiva. La era actual de la IA generativa representa un salto en la creatividad, con modelos capaces de producir contenido original en diversos medios. Esta progresión sugiere un futuro en el que la IA desempeñe un papel aún más integral en la creación de contenido, difuminando aún más las líneas entre la autoría humana y la de las máquinas.

La línea de tiempo del desarrollo de la IA en la creación de contenido revela un ritmo acelerado de innovación, particularmente en la última década con avances en el aprendizaje profundo y las arquitecturas Transformer. Las etapas iniciales de la investigación en IA fueron lentas, con una potencia informática limitada. Sin embargo, los avances en hardware y algoritmos, especialmente el desarrollo de técnicas de aprendizaje profundo y el modelo Transformer, han acelerado drásticamente las capacidades de la IA en la generación de contenido. La introducción de modelos como GPT y DALL-E en un corto período de tiempo significa una rápida progresión, lo que indica que el futuro probablemente traerá desarrollos aún más rápidos y transformadores en este campo. Esta rápida evolución plantea desafíos para la regulación y el desarrollo de métodos de identificación efectivos.

La Proliferación de Tecnologías de IA Generativa

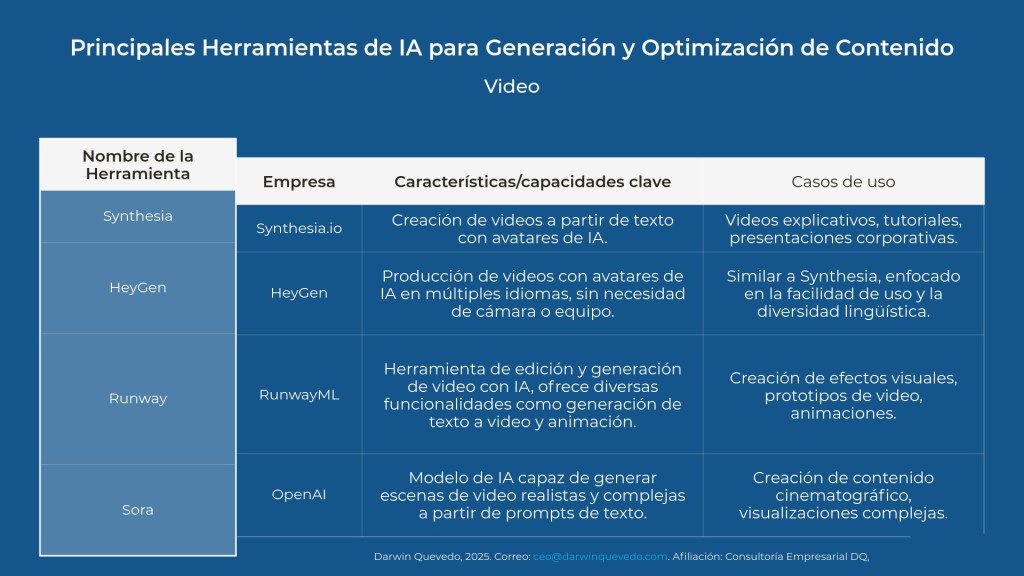

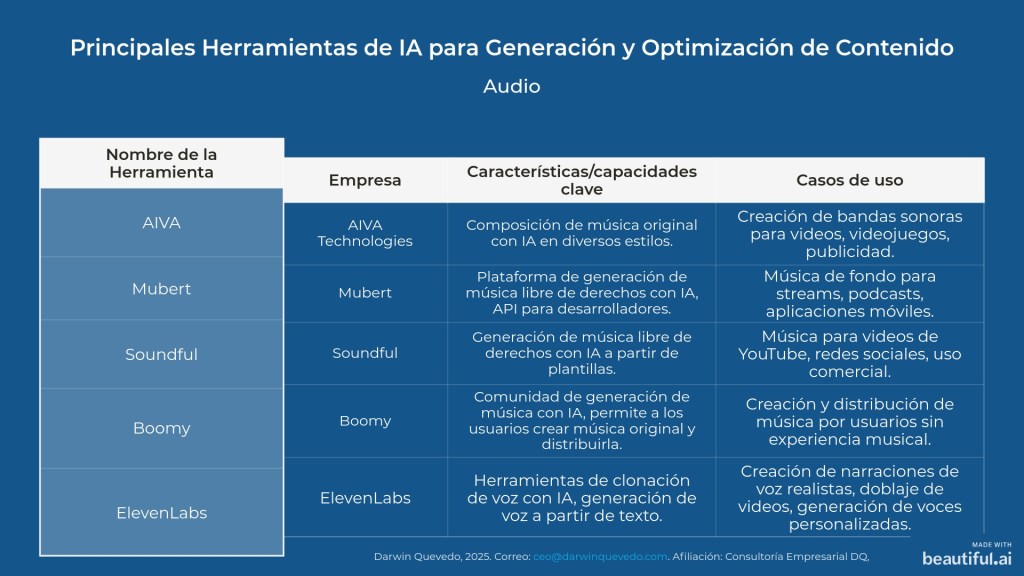

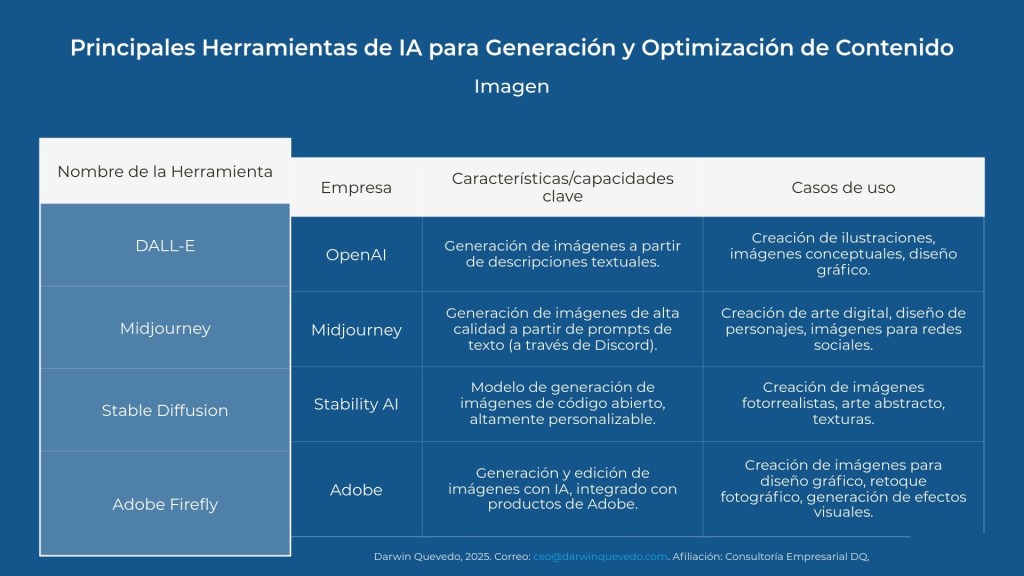

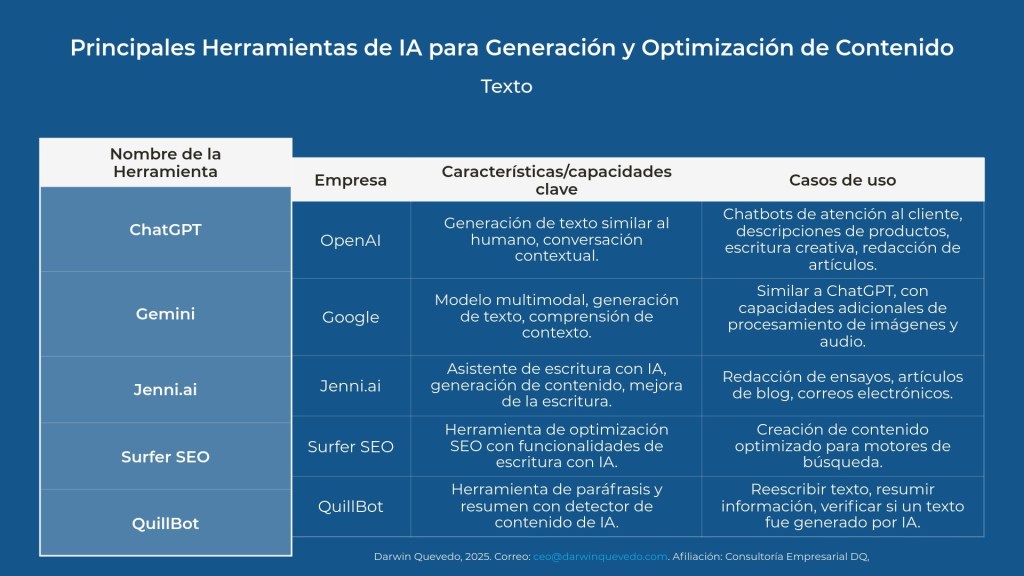

La proliferación de la inteligencia artificial generativa se manifiesta en una amplia gama de herramientas especializadas para la creación de diversos tipos de contenido digital. En el ámbito del texto, herramientas como ChatGPT de OpenAI y Gemini de Google, junto con varios asistentes de escritura con IA como Jenni.ai, Surfer SEO y QuillBot , permiten la generación de artículos, informes y otros formatos textuales con una eficiencia notable. Para la creación de imágenes, modelos como DALL-E de OpenAI , Midjourney , Stable Diffusion y Adobe Firefly han revolucionado la producción de contenido visual a partir de descripciones textuales o imágenes de referencia.

En el campo del audio, existen numerosas herramientas de generación de música con IA, como AIVA, Mubert, Soundful y Boomy , que permiten la creación de composiciones musicales originales en diversos géneros. Asimismo, las herramientas de clonación de voz, como ElevenLabs , ofrecen la posibilidad de replicar voces humanas con una precisión sorprendente. La creación de video también se ha visto transformada por herramientas como Synthesia , HeyGen , Runway y Sora de OpenAI , que permiten generar videos a partir de texto, imágenes o incluso movimientos de avatares.

Estas tecnologías de IA generativa están democratizando la creación de contenido al hacer que herramientas sofisticadas sean accesibles a individuos y pequeñas empresas que carecen de las habilidades o los recursos especializados necesarios para la producción tradicional . Tareas complejas como la edición de video, la composición musical y la generación de imágenes se han simplificado y automatizado .

Sin embargo, esta proliferación también ha generado crecientes preocupaciones sobre la autenticidad del contenido y el potencial de uso indebido . La dificultad para distinguir el contenido generado por IA del creado por humanos plantea interrogantes sobre la confianza y la integridad de la información . Existe el riesgo de propagar información errónea, crear deepfakes, infringir la propiedad intelectual y generar contenido sesgado o dañino . Además, surgen inquietudes sobre el impacto en los creadores humanos y el valor del trabajo original .

La accesibilidad y la facilidad de uso de las herramientas de IA generativa están provocando un aumento exponencial en el volumen de contenido digital, lo que hace que la tarea de identificar el material generado por IA sea cada vez más desafiante y crítica. A medida que las herramientas de IA se vuelven más fáciles de usar, la producción de contenido digital ya no se limita a los profesionales. Este aumento en la creación de contenido, una parte significativa del cual es generado por IA, sobrepasa los mecanismos existentes para verificar la autenticidad. El gran volumen hace que la revisión manual sea imposible, y la sofisticación de la IA hace que la detección visual o auditiva no sea confiable. Esto requiere métodos automatizados y robustos para identificar el contenido de IA a gran escala.Si bien la IA generativa democratiza la creación de contenido, también introduce un riesgo significativo de diluir el valor de la creatividad humana y potencialmente perturbar los medios de vida de artistas, escritores, músicos y otros profesionales creativos. La capacidad de la IA para generar contenido de forma rápida y a gran escala, a veces imitando el estilo de los creadores humanos, plantea preocupaciones sobre la infracción de derechos de autor y la compensación justa. Si el contenido generado por IA se vuelve ubicuo y fácilmente accesible, la demanda de trabajo creado por humanos podría disminuir, lo que generaría desafíos económicos para quienes trabajan en las industrias creativas. Esta posible devaluación del arte humano subraya la necesidad de regulaciones y directrices éticas que rijan el uso de la IA en la creación de contenido.

Respuestas Regulatorias Globales al Contenido Generado por IA

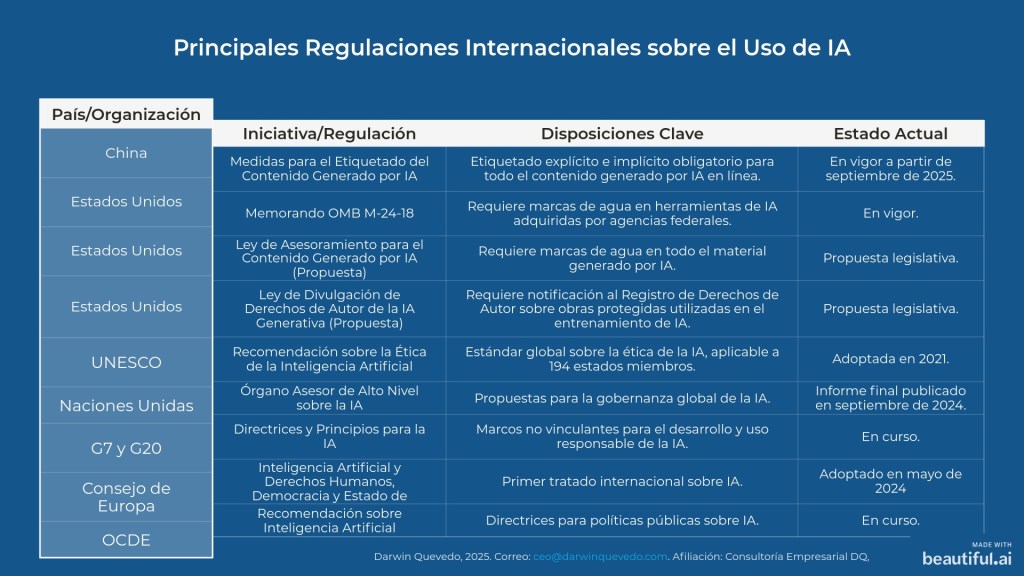

A nivel global, diversos países y organizaciones internacionales están comenzando a abordar los desafíos regulatorios que plantea la creciente presencia de contenido generado por inteligencia artificial. Más allá de las iniciativas en España y la Unión Europea, otras regiones han implementado o propuesto medidas para el etiquetado y la regulación de este tipo de contenido.

China ha adoptado una postura firme al anunciar que, a partir de septiembre de 2025, todo el contenido generado por IA deberá estar claramente etiquetado en línea . Esta regulación, emitida por la Administración del Ciberespacio de China junto con otros tres reguladores, exige que todas las formas de contenido generado por IA, incluyendo texto, imágenes, audio y video, se marquen para identificar su origen. Las reglas imponen obligaciones de etiquetado explícito (indicadores visibles como texto o gráficos) e implícito (metadatos incrustados) en los proveedores de servicios de información en Internet y los proveedores de servicios de distribución de contenido en línea que crean contenido generado por IA . Se espera que esta medida mejore la transparencia y la rendición de cuentas en el panorama digital, permitiendo a los usuarios ser conscientes de la fuente de la información que consumen y combatiendo la propagación de la desinformación .

En Estados Unidos, la respuesta regulatoria es más incipiente, pero también se están tomando medidas. La Oficina de Administración y Presupuesto (OMB) emitió un memorando en septiembre de 2024 que especifica que las agencias federales que adquieran herramientas de IA para uso empresarial deben exigir a los proveedores que implementen marcas de agua . Además, se han propuesto leyes como la Ley de Asesoramiento para el Contenido Generado por IA y la Ley de Divulgación de Derechos de Autor de la IA Generativa . A nivel estatal, también se están explorando diversas propuestas regulatorias en materia de IA .

Diversas organizaciones internacionales también están trabajando en marcos regulatorios y éticos para la IA. La UNESCO publicó en 2021 la primera norma mundial sobre ética de la IA, la «Recomendación sobre la Ética de la Inteligencia Artificial» , y ha establecido el Observatorio Mundial de Ética y Gobernanza de la IA . Las Naciones Unidas han creado un Órgano Asesor de Alto Nivel sobre la IA y han publicado un informe con propuestas para la gobernanza global de la IA . El G7 y el G20 han desarrollado directrices y principios no vinculantes para la IA . El Consejo de Europa adoptó el primer tratado internacional sobre IA, el Convenio Marco sobre Inteligencia Artificial y Derechos Humanos, Democracia y Estado de Derecho . La OCDE también ha publicado una «Recomendación sobre Inteligencia Artificial» .

Estas iniciativas regulatorias, aunque bien intencionadas, enfrentan varios desafíos y presentan posibles implicaciones. La aplicabilidad de estas regulaciones es un obstáculo importante, dada la naturaleza global del contenido en línea y la creciente capacidad de la IA para eludir la detección . La existencia de leyes internacionales inconsistentes significa que el contenido generado por IA de países sin normas de etiquetado puede circular libremente sin identificación . Definir con precisión qué constituye «contenido generado por IA» y cómo abordar el contenido que es parcialmente generado por IA o asistido por IA también es un desafío . Existe la preocupación de que una regulación excesiva pueda sofocar la innovación y el despliegue de tecnologías de IA beneficiosas . Es crucial equilibrar la transparencia con la libertad de expresión para garantizar que las regulaciones no restrinjan indebidamente los usos creativos o periodísticos de la IA. Finalmente, existen desafíos técnicos para implementar mecanismos de etiquetado efectivos y robustos que no puedan ser fácilmente eludidos .

El panorama regulatorio global para el contenido generado por IA está fragmentado y aún en sus primeras etapas, con enfoques y niveles de aplicación variables entre las diferentes regiones, lo que plantea un desafío significativo para establecer estándares universales y garantizar una identificación efectiva. Si bien algunas regiones como China están adoptando una postura firme con el etiquetado obligatorio, otras se están centrando en directrices voluntarias o aplicaciones específicas de la IA. Esta falta de uniformidad crea lagunas y dificulta el seguimiento y la gestión del contenido generado por IA a través de las fronteras. La ausencia de un marco regulatorio coordinado a nivel mundial dificulta el desarrollo de prácticas de identificación consistentes y podría conducir a un arbitraje regulatorio.

Las iniciativas regulatorias están lidiando con la tensión entre la promoción de la innovación en la IA y la mitigación de los riesgos asociados con su uso indebido en la creación de contenido, lo que destaca la necesidad de políticas adaptativas y matizadas que puedan seguir el ritmo de la tecnología en rápida evolución. Los responsables de la formulación de políticas están tratando de lograr un equilibrio entre el fomento de los beneficios económicos y sociales de la IA y la atención de las preocupaciones sobre la desinformación, la infracción de derechos de autor y las implicaciones éticas. Las regulaciones demasiado estrictas podrían sofocar la innovación, mientras que una supervisión insuficiente podría exacerbar los riesgos. Este delicado equilibrio requiere un diálogo continuo entre los gobiernos, la industria y los investigadores para desarrollar marcos regulatorios flexibles y efectivos que puedan adaptarse a los futuros avances en la IA.

La Ciencia de las Marcas de Agua Digitales para Contenido de IA

Se están desarrollando diversas técnicas de marcas de agua digitales con el objetivo de identificar el contenido generado por inteligencia artificial. Estas técnicas buscan insertar información de manera imperceptible en el contenido, de modo que pueda verificarse su origen sin alterar significativamente su calidad o apariencia .

Las marcas de agua visibles son una de las formas más sencillas, consistiendo en superponer logotipos, texto, firmas o gráficos en el contenido . Si bien son fáciles de detectar por el ojo humano, pueden comprometer la estética del contenido y son relativamente fáciles de eliminar mediante técnicas de edición o recorte .

Las marcas de agua invisibles implican la incrustación de datos ocultos dentro del contenido. En imágenes y video, esto puede lograrse manipulando los valores de los píxeles . Por ejemplo, se pueden modificar los bits menos significativos de una imagen para codificar información sin que el cambio sea perceptible para el ojo humano . En audio, las marcas de agua invisibles se pueden incrustar en la forma de onda o en el espectrograma del sonido . Para el texto, las técnicas incluyen la esteganografía lingüística (alteraciones sutiles en el orden de las palabras o el uso de sinónimos), el uso de características estadísticas (como la frecuencia de ciertos n-gramas) y la codificación mediante códigos de corrección de errores .

Los métodos de inserción varían. Algunas técnicas se aplican durante el proceso de generación del contenido, lo que requiere acceso al modelo de IA subyacente . Otras se aplican después de la producción del contenido, utilizando herramientas externas o mediante la adición de metadatos .

La robustez contra manipulaciones es un aspecto crucial de las marcas de agua digitales. Idealmente, una marca de agua debería resistir técnicas comunes de edición como el recorte, el cambio de tamaño, la rotación, la compresión, la adición de ruido y el filtrado . Sin embargo, mantener la robustez contra ataques intencionales por parte de quienes buscan eliminar o eludir las marcas de agua es un desafío significativo . En el caso del texto, la robustez contra la paráfrasis y la traducción también es importante . Se han propuesto marcas de agua criptográficas que utilizan técnicas de cifrado para ofrecer garantías matemáticas de robustez y resistencia a la manipulación . Otra técnica es la proveniencia del contenido, que incrusta y mantiene de forma segura información sobre el origen del contenido en sus metadatos, siguiendo estándares como el de la Coalición para la Procedencia y Autenticidad del Contenido (C2PA) .

A pesar de los avances, las limitaciones de estas técnicas son significativas. Existe una contrapartida inherente entre la imperceptibilidad, la robustez y la capacidad (la cantidad de información que la marca de agua puede transportar) . Las marcas de agua robustas que son difíciles de eliminar pueden ser más perceptibles, afectando la calidad del contenido. Las marcas de agua imperceptibles pueden ser fácilmente eliminadas mediante edición o ataques adversarios. La cantidad de información que una marca de agua puede transportar también es limitada. Las marcas de agua también pueden ser frágiles a ciertos tipos de manipulación, como la desincronización o la alteración de bits . La detección de ciertas marcas de agua requiere la cooperación del desarrollador del modelo de IA , y los modelos de IA de código abierto presentan desafíos particulares para el marcado de agua .

Si bien diversas técnicas de marcas de agua digitales muestran ser prometedoras para identificar el contenido generado por IA, lograr un equilibrio entre robustez, imperceptibilidad y capacidad sigue siendo un desafío técnico significativo, y ningún método único ha demostrado ser universalmente efectivo y resistente a todas las formas de manipulación. Las marcas de agua robustas que son difíciles de eliminar podrían ser más perceptibles, afectando la calidad del contenido. Las marcas de agua imperceptibles podrían ser fácilmente eliminadas mediante edición o ataques adversarios. La cantidad de información que una marca de agua puede transportar también es limitada. Esta contrapartida inherente requiere una investigación y un desarrollo continuos de técnicas de marcas de agua más sofisticadas que puedan equilibrar mejor estos requisitos contrapuestos.

La eficacia del marcado de agua depende en gran medida del tipo específico de contenido (texto, imagen, audio, video) y de la naturaleza de las posibles manipulaciones, lo que sugiere que podría ser necesario un enfoque multicapa que incorpore diversas técnicas y estándares para una identificación integral del contenido generado por IA. Los diferentes formatos de medios tienen características únicas que afectan la forma en que se pueden incrustar y detectar las marcas de agua. Por ejemplo, el marcado de agua en texto se basa en patrones lingüísticos sutiles, mientras que el marcado de agua en imágenes manipula los valores de los píxeles. Los tipos de manipulaciones que son efectivas contra un tipo de marca de agua podrían no funcionar contra otro. Esta variabilidad subraya la necesidad de una combinación de estrategias de marcado de agua, potencialmente adaptadas a tipos de medios específicos, junto con estándares de la industria para la implementación y la detección.

Más Allá de la Marca: Evaluación de la Eficacia del Marcado de Agua

Si bien las marcas de agua digitales representan un enfoque prometedor para identificar el contenido generado por IA, es crucial analizar críticamente su eficacia como solución única. La evidencia sugiere que las marcas de agua por sí solas probablemente no sean una solución infalible debido a sus limitaciones inherentes y al potencial para ser eludidas .

Se han desarrollado varios métodos para eludir las marcas de agua. Las marcas de agua visibles pueden eliminarse mediante el recorte o la edición de la imagen . La información de la marca de agua incrustada en los metadatos también puede eliminarse . En el caso de las marcas de agua invisibles en imágenes o audio, se pueden manipular los bits menos perceptibles . Para el texto, la paráfrasis o la traducción a otro idioma y la posterior traducción de vuelta pueden eliminar las marcas de agua basadas en patrones lingüísticos específicos . Incluso se pueden utilizar algoritmos de eliminación de ruido y modelos de IA entrenados específicamente para reconocer y eliminar marcas de agua imperceptibles .

La eficacia de las marcas de agua también se ve comprometida por las implicaciones de los falsos positivos y negativos. Un falso positivo ocurre cuando el contenido creado por humanos se identifica incorrectamente como generado por IA, lo que puede llevar a acusaciones injustas de plagio, pérdida de confianza y resultados inequitativos, especialmente para hablantes no nativos de inglés . Un falso negativo, por otro lado, ocurre cuando el contenido generado por IA no se detecta, lo que permite que la desinformación y el contenido dañino proliferen .

Diversos estudios y artículos han evaluado la viabilidad a largo plazo de las marcas de agua. Existe la preocupación de que se produzca una «carrera armamentista» continua entre las técnicas de marcado de agua y los métodos de evasión, lo que haría que las marcas de agua fueran perpetuamente vulnerables . Por lo tanto, se sugiere considerar el marcado de agua como parte de un sistema más amplio de autenticación de contenido y alfabetización mediática .

El desarrollo continuo de métodos para eludir las marcas de agua digitales destaca las limitaciones de depender únicamente de esta tecnología para identificar el contenido generado por IA y sugiere la necesidad de estrategias de detección complementarias y marcos de autenticación robustos. A medida que las técnicas de marcado de agua se vuelven más sofisticadas, también lo hacen los métodos para sortearlas. Este ciclo continuo indica que el marcado de agua por sí solo no puede proporcionar una solución definitiva para identificar el contenido de IA. La facilidad con la que se pueden eliminar o hacer indetectables las marcas de agua requiere un enfoque más amplio que incluya herramientas de detección de IA, iniciativas de procedencia de contenido y educación en alfabetización mediática.

El potencial de falsos positivos y falsos negativos en la detección de contenido de IA subraya la importancia crítica de la precisión y la confiabilidad en cualquier método de identificación, especialmente en contextos de alto riesgo como la educación, el periodismo y los procedimientos legales. Los falsos positivos pueden tener consecuencias graves, incluidas acusaciones injustificadas y daños a la reputación. Los falsos negativos pueden socavar los esfuerzos para combatir la desinformación y garantizar la integridad de la información. Por lo tanto, cualquier sistema de detección de contenido de IA debe esforzarse por lograr una alta precisión y minimizar ambos tipos de errores para ser ética y prácticamente viable. Esto requiere pruebas rigurosas, transparencia sobre las tasas de error y una cuidadosa consideración del contexto en el que se utilizan las herramientas.

El Panorama de la Detección: Herramientas y Metodologías para Identificar Contenido de IA

En el mercado actual, existe una variedad de herramientas comerciales diseñadas para detectar contenido generado por inteligencia artificial. Entre ellas se encuentran AI Detector , GPTZero , Originality.AI , el Detector de IA de QuillBot , el Detector de Contenido de IA de Surfer , ZeroGPT , Undetectable AI , Corrector App , Copyleaks , Content At Scale (BrandWell) , Writefull GPT Detector y el verificador beta de Grammarly .

Las metodologías empleadas por estas herramientas varían. Para el análisis de texto, se utilizan algoritmos de procesamiento del lenguaje natural (PNL), análisis lingüístico, análisis de sentimiento y análisis estadístico de la elección de palabras y la estructura de las oraciones, así como el análisis de n-gramas, sintáctico y semántico . En el análisis de imágenes, se utilizan la búsqueda inversa de imágenes, técnicas de detección de manipulación de imágenes y modelos de aprendizaje profundo para el reconocimiento de patrones . El análisis de video implica el análisis de fotogramas, el análisis de audio y modelos de aprendizaje profundo para detectar inconsistencias . Algunas herramientas también utilizan métricas como la perplejidad y la explosividad (burstiness) para medir la predictibilidad y la variabilidad del texto . Un enfoque común es la comparación con conjuntos de datos para identificar patrones comunes en el contenido generado por IA en contraposición al contenido escrito por humanos .

Los niveles de precisión de estas herramientas varían significativamente según la herramienta y el tipo de contenido . Muchas herramientas tienen una tasa considerable de falsos positivos, identificando incorrectamente contenido escrito por humanos como generado por IA . También existen falsos negativos, donde el contenido generado por IA no se detecta . La precisión puede verse afectada por la complejidad de la instrucción (prompt), el modelo utilizado para la generación y si el texto generado por IA ha sido humanizado o editado .

La mayoría de estas herramientas se centran principalmente en el análisis de texto, aunque algunas ofrecen detección de imágenes y una capacidad limitada para video y audio .

Los generadores de IA podrían utilizar diversas estrategias para evadir la detección. Estas incluyen la reformulación de la estructura y el formato de las oraciones , el uso de sinónimos y palabras similares , el empleo de técnicas de instrucción avanzadas y el encadenamiento de instrucciones , la humanización del texto generado por IA mediante la edición y el uso de herramientas de paráfrasis con IA para reescribir el contenido generado por IA .

Las herramientas actuales de detección de contenido de IA, aunque en rápida evolución, aún sufren limitaciones en cuanto a precisión y confiabilidad, particularmente con el texto, lo que las hace inadecuadas como base única para decisiones de alto riesgo debido al riesgo de falsos positivos y la capacidad de la IA para evadir la detección. Las metodologías utilizadas por las herramientas de detección de IA se basan en la identificación de patrones estadísticos y características lingüísticas que son comunes en el contenido generado por IA. Sin embargo, estos patrones no siempre son exclusivos de la IA, y la escritura humana a veces puede exhibir características similares, lo que lleva a falsos positivos. Además, se están desarrollando modelos de IA con el objetivo explícito de generar texto similar al humano que pueda eludir estos detectores, lo que indica una «carrera armamentista» en curso que dificulta que las herramientas de detección mantengan un alto nivel de precisión.

La falta de un método de detección de contenido de IA universalmente preciso y confiable subraya la necesidad de un enfoque multifacético para abordar los desafíos que plantea el contenido generado por IA, combinando soluciones tecnológicas con el juicio humano, la educación en alfabetización mediática y las directrices éticas. Dadas las limitaciones de la tecnología actual de detección de IA, depender únicamente de estas herramientas es insuficiente. Una estrategia más integral implica educar a los usuarios sobre cómo evaluar críticamente el contenido digital, promover la transparencia sobre el uso de la IA en la creación de contenido y establecer estándares éticos tanto para la generación como para el consumo de material generado por IA. La supervisión humana y el pensamiento crítico siguen siendo esenciales para navegar por el panorama cambiante del contenido de IA.

Políticas de Plataformas y Perspectivas de la Industria sobre el Contenido de IA

Diversas plataformas digitales han comenzado a implementar políticas e iniciativas con respecto a la identificación y el etiquetado de contenido generado por IA. YouTube requiere que los creadores divulguen el contenido significativamente alterado o generado sintéticamente que parezca realista utilizando una configuración de «contenido alterado» . El contenido creado con las herramientas de IA de YouTube (Dream Track, Dream Screen) se divulga automáticamente . YouTube fomenta el uso responsable de la IA, pero prohíbe el contenido dañino o engañoso . En algunos casos, puede etiquetar proactivamente el contenido no divulgado y penalizar la falta constante de divulgación .

TikTok alienta a los creadores a etiquetar el contenido significativamente editado o generado en su totalidad por IA utilizando texto, hashtags o una configuración dedicada de «contenido generado por IA» . TikTok puede aplicar automáticamente una etiqueta de «generado por IA» utilizando las Credenciales de Contenido (C2PA) o cuando se utilizan efectos de IA de TikTok . Prohíbe el contenido generado por IA que muestre fuentes autorizadas falsas, eventos de crisis o tergiverse a figuras públicas o individuos privados .

X (anteriormente Twitter) actualizó su política de privacidad para permitir el uso del contenido generado por los usuarios para entrenar modelos de IA, a menos que los usuarios opten por no participar . Se han planteado preocupaciones sobre la privacidad, la propiedad intelectual y la capacidad de optar por no participar .

Los diferentes actores de la industria creativa han expresado diversas posturas sobre el uso de la IA y han propuesto medidas para proteger sus derechos y la autenticidad de su trabajo. La industria musical ha manifestado su preocupación por la infracción de derechos de autor, el uso no autorizado de las voces de los artistas y la posible devaluación del arte humano . Han propuesto legislación que exija transparencia en los datos de entrenamiento de la IA (Ley TRAIN) , el fortalecimiento de la protección de los derechos de autor y la garantía de una compensación justa por el uso de su trabajo . Se oponen a los sistemas de exclusión voluntaria para el entrenamiento de la IA .

En las artes visuales, existen preocupaciones sobre la propiedad, la infracción de derechos de autor, la privacidad y los sesgos en las imágenes generadas por IA . Se han propuesto directrices más claras sobre derechos de autor, leyes de privacidad de datos más estrictas, estándares para datos de entrenamiento justos y soluciones basadas en licencias . También se apoya iniciativas como la Ley de Divulgación de Derechos de Autor de la IA Generativa y la certificación Fairly Trained .

En el periodismo, las preocupaciones se centran en la precisión, las consideraciones éticas, el potencial de sesgos y la infracción de derechos de autor . Se han propuesto medidas para respetar los derechos de propiedad intelectual, apoyar las licencias voluntarias, promover la transparencia y garantizar una competencia justa en el sector de la IA y la tecnología . Se enfatiza la importancia del periodismo humano y la necesidad de regulación .

En la escritura, las preocupaciones incluyen la infracción de derechos de autor, la pérdida de control creativo, la mala interpretación del contexto y el uso ético del contenido generado por IA . Se han propuesto medidas para establecer directrices y regulaciones claras, garantizar que el desarrollo de la IA respete los derechos de los autores y centrarse en la IA como una herramienta para aumentar la creatividad humana en lugar de reemplazarla .

Las plataformas digitales están comenzando a implementar políticas para la divulgación de contenido generado por IA, pero los enfoques varían y la efectividad de estas medidas para garantizar una transparencia generalizada aún está siendo evaluada. Si bien algunas plataformas como YouTube y TikTok tienen mecanismos específicos para etiquetar el contenido de IA, otras como X se están centrando en el uso de datos de usuario para el entrenamiento de IA con opciones de exclusión voluntaria. Las inconsistencias en estas políticas y la dependencia de la divulgación por parte del usuario plantean interrogantes sobre el grado en que informarán eficazmente al público sobre el origen del contenido digital.

En diversas industrias creativas, existe un fuerte consenso sobre la necesidad de regulación y protección de los derechos de propiedad intelectual frente a los avances de las tecnologías de IA, con propuestas específicas que van desde requisitos de transparencia y acuerdos de licencia hasta leyes de derechos de autor más estrictas. Músicos, artistas visuales, periodistas y escritores expresan su preocupación por los posibles impactos negativos de la IA no regulada en sus medios de vida y la integridad de sus respectivos campos. Sus propuestas de regulación reflejan un deseo compartido de garantizar que el desarrollo de la IA respete los derechos de los creadores, proporcione una compensación justa por el uso de su trabajo y promueva la transparencia en cómo se entrenan e implementan los modelos de IA.

Navegando el Futuro de la IA en el Contenido – La Necesidad de Marcas de IA

La información recopilada a lo largo de este informe subraya la creciente necesidad de identificar el contenido generado por inteligencia artificial. La capacidad cada vez mayor de la IA para producir contenido digital indistinguible del creado por humanos plantea desafíos significativos para la transparencia, la confianza y la ética en el entorno digital. Si bien la IA ofrece numerosos beneficios en términos de eficiencia y creatividad, su potencial para la desinformación, la infracción de derechos de autor y otras formas de uso indebido exige la implementación de mecanismos de identificación efectivos.

A pesar de los avances en las técnicas de marcado de agua digital y las herramientas de detección de contenido de IA, persisten desafíos importantes. La «carrera armamentista» en curso entre la generación de IA y la detección/evasión sugiere que ninguna solución tecnológica única será completamente infalible. La falta de estándares y regulaciones universales a nivel global complica aún más la situación. Equilibrar la promoción de la innovación en la IA con la mitigación de sus riesgos éticos y sociales sigue siendo una tarea delicada. La naturaleza global del contenido digital requiere una cooperación internacional sólida para abordar estos desafíos de manera efectiva.

De cara al futuro, varias direcciones posibles podrían ayudar a lograr una convivencia informada y ética con la inteligencia artificial en la creación de contenido. El desarrollo de técnicas de marcado de agua más robustas y resistentes a la manipulación, como las marcas de agua criptográficas, podría mejorar la capacidad de rastrear el origen del contenido generado por IA. Los avances en las metodologías de detección de contenido de IA, que potencialmente incorporan análisis multimodales y biometría del comportamiento, podrían aumentar la precisión de la identificación. El establecimiento de estándares en toda la industria para el etiquetado de contenido de IA y los metadatos asociados es crucial para facilitar la verificación y la transparencia. La tecnología blockchain podría desempeñar un papel en la provisión de registros inmutables del origen y la autenticidad del contenido.

Además de las soluciones tecnológicas, la alfabetización mediática es fundamental para empoderar a los usuarios a evaluar críticamente la información que consumen. Fomentar una cultura de transparencia y uso responsable de la IA es esencial. Los esfuerzos de colaboración entre investigadores, la industria, los responsables de la formulación de políticas y los educadores son necesarios para abordar los desafíos multifacéticos de la IA en la creación de contenido. La propia IA podría utilizarse para ayudar a identificar y verificar el contenido generado por IA, creando un ciclo de mejora continua en la detección.

En última instancia, lograr una convivencia informada y ética con la IA en la creación de contenido requiere un enfoque multifacético que combine soluciones tecnológicas robustas con esfuerzos educativos y la adopción de estándares técnicos y éticos claros. Solo a través de un esfuerzo concertado se podrá aprovechar el potencial de la IA al tiempo que se mitigan sus riesgos y se protege la integridad del ecosistema de información digital.

Lograr una coexistencia informada y ética con la IA en la creación de contenido requiere un enfoque múltiple que combine soluciones tecnológicas para la identificación con esfuerzos sociales para promover la alfabetización mediática y establecer estándares éticos y técnicos claros. Ninguna solución única, ya sea el marcado de agua o la detección por IA, puede abordar completamente las complejidades del contenido generado por IA. Es necesario un enfoque holístico, que involucre el desarrollo de tecnologías de identificación más sofisticadas, la implementación de estándares de la industria para el etiquetado y la procedencia, la educación del público para evaluar críticamente los medios digitales y el establecimiento de directrices éticas para el uso de la IA en la creación de contenido. Este esfuerzo colaborativo será crucial para fomentar la confianza y garantizar la integración responsable de la IA en el panorama digital.

El futuro de la IA en la creación de contenido requiere un proceso continuo de adaptación e innovación en la identificación y la regulación, ya que la propia tecnología seguirá evolucionando a un ritmo rápido, exigiendo investigación, colaboración y ajustes de políticas continuos. El campo de la IA es dinámico, con nuevos modelos y capacidades que emergen con frecuencia. Esta constante evolución significa que los métodos para identificar el contenido generado por IA y las regulaciones que rigen su uso también deben ser adaptables. La investigación continua es esencial para desarrollar técnicas de detección y marcado de agua más efectivas. El diálogo y la colaboración continuos entre las partes interesadas son necesarios para refinar las directrices y políticas éticas en respuesta a futuros avances en la IA.

Por cierto: Este contenido ha sido redactado con la asistencia de inteligencia artificial.

Referencias

- AI Content Creation: The Future of Digital Storytelling – Magai, fecha de acceso: marzo 22, 2025, https://magai.co/ai-content-creation-the-future-of-digital-storytelling/

- The evolution of AI-generated content – AIContentfy, fecha de acceso: marzo 22, 2025, https://aicontentfy.com/en/blog/evolution-of-ai-generated-content

- Future of AI-Generated Content – Potential of Chat GPT-4 – SG Analytics, fecha de acceso: marzo 22, 2025, https://www.sganalytics.com/blog/future-of-ai-generated-content-chat-gpt4/

- AI Timeline – Generative A.I. – LibGuides at Barstow Community College, fecha de acceso: marzo 22, 2025, https://barstow.libguides.com/generative-ai/timeline

- How AI is Changing the Game in Content Creation – Jenni AI, fecha de acceso: marzo 22, 2025, https://jenni.ai/artificial-intelligence/writing-ai-generated-content

- Why AI-Generated Content Labeling Mandates Fall Short – Center for Data Innovation, fecha de acceso: marzo 22, 2025, https://www2.datainnovation.org/2024-ai-watermarking.pdf

- The 7 Best AI Video Generators for Creators and Marketers, Tried …, fecha de acceso: marzo 22, 2025, https://buffer.com/resources/ai-video-tools/

- The Fascinating History of AI in Content Creation: How We Got Here …, fecha de acceso: marzo 22, 2025, https://medium.com/@jayeshchaubey/the-fascinating-history-of-ai-in-content-creation-how-we-got-here-ff7d8b4e4adb

- A Brief History of AI: Transforming Content Creation | KLOK Istanbul Agency, fecha de acceso: marzo 22, 2025, https://www.klokist.com/blog/history-of-ai

- The History of AI: A Timeline of Artificial Intelligence | Coursera, fecha de acceso: marzo 22, 2025, https://www.coursera.org/articles/history-of-ai

- The Ultimate Timeline of Artificial Intelligence Technology – AIPRM, fecha de acceso: marzo 22, 2025, https://www.aiprm.com/timeline-of-ai-technology/

- The rise of generative AI: A timeline of breakthrough innovations | Qualcomm, fecha de acceso: marzo 22, 2025, https://www.qualcomm.com/news/onq/2024/02/the-rise-of-generative-ai-timeline-of-breakthrough-innovations

- AI in Publishing [Revolutionizing the Future of Content Creation and …, fecha de acceso: marzo 22, 2025, https://www.epublishing.com/news/2024/dec/05/ai-publishing/

- AI in Content Creation: The Future of Writing and Design | by Sudosu AI | Medium, fecha de acceso: marzo 22, 2025, https://medium.com/@sudosuai/ai-in-content-creation-the-future-of-writing-and-design-567eb3a097a2

- Generative AI in Creative and Content Generation: Complete Report | Research Reports, fecha de acceso: marzo 22, 2025, https://www.ana.net/miccontent/show/id/rr-2023-12-ana-generative-ai-creative-content

- AI Content Writing: How AI is Revolutionizing the Future of Content Creation – Digital Success Blog, fecha de acceso: marzo 22, 2025, https://www.digitalsuccess.us/blog/ai-content-writing-how-ai-is-revolutionizing-the-future-of-content-creation.html

- I Tested 6 AI Detectors. Here’s My Review About What’s The Best Tool for 2025. – Medium, fecha de acceso: marzo 22, 2025, https://medium.com/freelancers-hub/best-ai-detectors-2025-35a58eac86c5

- Take AI’s Mask Off: Use These 8 Best AI Detectors I Tried – G2 Learning Hub, fecha de acceso: marzo 22, 2025, https://learn.g2.com/best-ai-detectors

- 9 Best AI Content Detectors Reviewed – Surfer SEO, fecha de acceso: marzo 22, 2025, https://surferseo.com/blog/best-ai-content-detection-tools/

- The 7 best AI image generators in 2025 – Zapier, fecha de acceso: marzo 22, 2025, https://zapier.com/blog/best-ai-image-generator/

- 7 of the Best AI Image Generators for Creators and Marketers + Example Images – Buffer, fecha de acceso: marzo 22, 2025, https://buffer.com/resources/ai-image-generator/

- Tested: The Best AI Image Generators for 2025 – PCMag, fecha de acceso: marzo 22, 2025, https://www.pcmag.com/picks/the-best-ai-image-generators

- AI Image Generation Tools – MIT Sloan Teaching & Learning Technologies, fecha de acceso: marzo 22, 2025, https://mitsloanedtech.mit.edu/ai/tools/images/

- The best AI image generators of 2024: Tested and reviewed – ZDNet, fecha de acceso: marzo 22, 2025, https://www.zdnet.com/article/best-ai-image-generator/

- 10 AI Music Generators for Creators in 2025 | DigitalOcean, fecha de acceso: marzo 22, 2025, https://www.digitalocean.com/resources/articles/ai-music-generators

- AI for Music Production: 10 Tools to Produce Like a Pro, fecha de acceso: marzo 22, 2025, https://dittomusic.com/en/blog/ai-for-music-production-tools-for-musicians

- Are there any AI tools or websites that you use for music production? : r/ableton – Reddit, fecha de acceso: marzo 22, 2025, https://www.reddit.com/r/ableton/comments/1i28h0l/are_there_any_ai_tools_or_websites_that_you_use/

- Top 3 AI Tools For Audio [Reviewed 2024], fecha de acceso: marzo 22, 2025, https://allthingsai.com/category/audio

- Generative AI Audio Tools and Applications: Searle Center – Northwestern University, fecha de acceso: marzo 22, 2025, https://searle.northwestern.edu/resources/our-tools-guides/learning-teaching-guides/generative-ai-audiotools.html

- Future of Podcasting: AI — Message Heard, fecha de acceso: marzo 22, 2025, https://messageheard.com/media-hub-new/future-of-podcasting-ai

- AI audio tools are shaping the future of content creation | ElevenLabs, fecha de acceso: marzo 22, 2025, https://elevenlabs.io/blog/how-ai-audio-tools-are-shaping-the-future-of-content-creation

- AI Video Generator Examples – Media Creation with Generative AI – Research – Guides, fecha de acceso: marzo 22, 2025, https://guides.library.georgetown.edu/c.php?g=1432323&p=10678252

- The 11 best AI video generators in 2025 | Zapier, fecha de acceso: marzo 22, 2025, https://zapier.com/blog/best-ai-video-generator/

- AI: its impact on video content creation – Yuzzit, fecha de acceso: marzo 22, 2025, https://www.yuzzit.video/en/resources/impact-ai-video-content-creation

- The Future of Content Creation: How AI Tools are Changing the Game – AIContentfy, fecha de acceso: marzo 22, 2025, https://aicontentfy.com/en/blog/future-of-content-creation-how-ai-tools-are-changing-game

- The Future of AI in Video Production: Innovations and Impacts – Filmustage Blog, fecha de acceso: marzo 22, 2025, https://filmustage.com/blog/the-future-of-ai-in-video-production-innovations-and-impacts/

- A Look at What The Future Holds for AI in Video Editing – ECG Productions, fecha de acceso: marzo 22, 2025, https://www.ecgprod.com/what-the-future-holds-for-ai-in-video-editing/

- How AI Is Transforming the Video Production Landscape – Streaming Media, fecha de acceso: marzo 22, 2025, https://www.streamingmedia.com/Articles/Editorial/Featured-Articles/How-AI-Is-Transforming-the-Video-Production-Landscape-166104.aspx

- The Role of AI in Enhancing Video Content Creation – ShoutOut Social, fecha de acceso: marzo 22, 2025, https://www.shoutout.social/the-role-of-ai-in-enhancing-video-content-creation-a-game-changer-in-the-digital-era/

- The Future of Audio AI | Cloud Computing & SaaS Awards, fecha de acceso: marzo 22, 2025, https://www.cloud-awards.com/the-future-of-audio-ai

- 11 Best AI Video Generators to Use – HubSpot Blog, fecha de acceso: marzo 22, 2025, https://blog.hubspot.com/marketing/ai-video-generator

- The State of AI: Global survey | McKinsey, fecha de acceso: marzo 22, 2025, https://www.mckinsey.com/capabilities/quantumblack/our-insights/the-state-of-ai

- The End of Traditional Media? AI’s Impact on Content Creation (The End of an Era), fecha de acceso: marzo 22, 2025, https://winningwp.com/the-end-of-an-era-how-ai-is-reshaping-content-creation-across-mediums/

- The Future of AI in Content Creation: Advantages, Pitfalls, and What’s Next in 2025, fecha de acceso: marzo 22, 2025, https://witgroupagency.com/future-ai-content-creation-advantages-pitfalls-2025/

- The Future of AI in Content Creation: Trends and Predictions | by Moses Nartey | Medium, fecha de acceso: marzo 22, 2025, https://medium.com/@mosesnartey47/the-future-of-ai-in-content-creation-trends-and-predictions-41b0f8b781ca

- Adobe 2025 AI and Digital Trends | Key Insights & Future Growth, fecha de acceso: marzo 22, 2025, https://business.adobe.com/resources/digital-trends-report.html

- China Mandates AI Content Labeling by 2025 – AInvest, fecha de acceso: marzo 22, 2025, https://www.ainvest.com/news/china-mandates-ai-content-labeling-2025-2503/

- All AI-Generated Material Must Be Labeled Online, China Announces – Futurism, fecha de acceso: marzo 22, 2025, https://futurism.com/ai-generated-material-labeled-china

- Watermarking in Images Will Not Solve AI-Generated Content Abuse, fecha de acceso: marzo 22, 2025, https://datainnovation.org/2024/08/watermarking-in-images-will-not-solve-ai-generated-content-abuse/

- All creatives should know about the ethics of AI-generated images | Lummi, fecha de acceso: marzo 22, 2025, https://www.lummi.ai/blog/ethics-of-ai-generated-images

- The Ethics of AI Art – Center for Media Engagement, fecha de acceso: marzo 22, 2025, https://mediaengagement.org/research/the-ethics-of-ai-art/

- Artificial Intelligence in Journalism – Center for News, Technology & Innovation, fecha de acceso: marzo 22, 2025, https://innovating.news/article/ai-in-journalism/

- The Problem with AI-Generated Music – The Cornell Daily Sun, fecha de acceso: marzo 22, 2025, https://cornellsun.com/2024/12/06/the-problem-with-ai-generated-music/

- Opinion: Generative AI’s Profound Impact on the Music Industry – The Red Line Project, fecha de acceso: marzo 22, 2025, https://redlineproject.news/2024/11/10/opinion-generative-ais-profound-impact-on-the-music-industry/

- 7 Increasing Concerns Authors Have About Their Work Being Used to Train AI Models, fecha de acceso: marzo 22, 2025, https://ebookfairs.com/Blog/post/author-concern-ai-models

- Writing with AI decreases authenticity – Tropolitan, fecha de acceso: marzo 22, 2025, https://www.tropnews.com/post/writing-with-ai-decreases-authenticity

- Hundreds of actors and Hollywood insiders sign open letter urging government not to loosen copyright laws for AI – CBS News, fecha de acceso: marzo 22, 2025, https://www.cbsnews.com/news/actors-artificial-intelligence-ai-hollywood-copyright-regulation/

- Fighting against AI exploitation in music – The Ivors Academy, fecha de acceso: marzo 22, 2025, https://ivorsacademy.com/news/fighting-against-ai-exploitation-in-music/

- AI Transparency Bill Gets Music Industry Backing – Ludwig Van Weekly, fecha de acceso: marzo 22, 2025, https://www.ludwig-van.com/main/2024/12/02/ai-transparency-bill-gets-music-industry-backing/

- What Will The Government’s Proposed Changes to the Rules on Copyright and Artificial Intelligence Mean for the UK Music Industry?, fecha de acceso: marzo 22, 2025, https://www.ukmusic.org/news/what-will-the-governments-proposed-changes-to-the-rules-on-copyright-and-artificial-intelligence-mean-for-the-uk-music-industry/

- Major labels rally against UK government’s AI copyright proposal – RouteNote Blog, fecha de acceso: marzo 22, 2025, https://routenote.com/blog/major-labels-rally-against-uk-governments-ai-copyright-proposal/

- Music industry backs new ‘TRAIN Act’ requiring transparency in materials used to train AI, fecha de acceso: marzo 22, 2025, https://www.musicbusinessworldwide.com/music-industry-backs-new-train-act-requiring-transparency-in-materials-used-to-train-ai/

- China Releases New Labeling Requirements for AI-Generated Content – Inside Privacy, fecha de acceso: marzo 22, 2025, https://www.insideprivacy.com/international/china/china-releases-new-labeling-requirements-for-ai-generated-content/

- AI Updates – Artists Rights Society, fecha de acceso: marzo 22, 2025, https://arsny.com/ai-updates/

- The Coming Year of AI Regulation in the States | TechPolicy.Press, fecha de acceso: marzo 22, 2025, https://www.techpolicy.press/the-coming-year-of-ai-regulation-in-the-states/

- Ethics of Artificial Intelligence | UNESCO, fecha de acceso: marzo 22, 2025, https://www.unesco.org/en/artificial-intelligence/recommendation-ethics

- AI Advisory Body – the United Nations, fecha de acceso: marzo 22, 2025, https://www.un.org/en/ai-advisory-body

- Regulating Under Uncertainty: Governance Options for Generative AI – Cyber Policy Center, fecha de acceso: marzo 22, 2025, https://cyber.fsi.stanford.edu/content/regulating-under-uncertainty-governance-options-generative-ai

- Global AI Law and Policy Tracker – IAPP, fecha de acceso: marzo 22, 2025, https://iapp.org/resources/article/global-ai-legislation-tracker/

- About AI-generated content – TikTok Help Center, fecha de acceso: marzo 22, 2025, https://support.tiktok.com/en/using-tiktok/creating-videos/ai-generated-content

- The Secret Language of AI Watermarks for GenAI Text: The Key to Building Trust in the Age of LLMs – Medium, fecha de acceso: marzo 22, 2025, https://medium.com/google-cloud/watermarks-for-genai-text-4494816a0e27

- AI Watermarking 101: Tools and Techniques – Hugging Face, fecha de acceso: marzo 22, 2025, https://huggingface.co/blog/watermarking

- SORA : Why Watermarks Devalue AI Products and Should Be Removed, fecha de acceso: marzo 22, 2025, https://community.openai.com/t/sora-why-watermarks-devalue-ai-products-and-should-be-removed/1085645

- Guide to Watermarking AI-Generated Content for Trust – QuickCreator, fecha de acceso: marzo 22, 2025, https://quickcreator.io/blog/guide-watermarking-ai-generated-content-trust/

- AI Watermarking Won’t Curb Disinformation | Electronic Frontier Foundation, fecha de acceso: marzo 22, 2025, https://www.eff.org/deeplinks/2024/01/ai-watermarking-wont-curb-disinformation

- How AI Can Remove Imperceptible Watermarks | by Max Hilsdorf | TDS Archive – Medium, fecha de acceso: marzo 22, 2025, https://medium.com/towards-data-science/how-ai-can-remove-imperceptible-watermarks-6b4560ea867a

- SynthID – Google DeepMind, fecha de acceso: marzo 22, 2025, https://deepmind.google/technologies/synthid/

- Meta’s Digital Watermark – A seal against digital manipulation of data – Puthrans, fecha de acceso: marzo 22, 2025, https://www.puthrans.com/metas-digital-watermark-a-seal-against-digital-manipulation-of-data/

- deepmind.google, fecha de acceso: marzo 22, 2025, https://deepmind.google/technologies/synthid/#:~:text=SynthID%20uses%20a%20variety%20of,and%20identifying%20AI%2Dgenerated%20content.&text=SynthID%20embeds%20a%20digital%20watermark,without%20compromising%20the%20original%20content.

- Adding Digital Watermarks with AI | Restackio, fecha de acceso: marzo 22, 2025, https://www.restack.io/p/watermarking-techniques-answer-adding-digital-watermarks-ai-cat-ai

- InvisMark: Invisible and Robust Watermarking for AI-Generated Image Provenance – CVF Open Access, fecha de acceso: marzo 22, 2025, https://openaccess.thecvf.com/content/WACV2025/papers/Xu_InvisMark_Invisible_and_Robust_Watermarking_for_AI-Generated_Image_Provenance_WACV_2025_paper.pdf

- AI-Powered Audio Watermarking: Protect Your Content | by Ali Onar | Sonic8 | Medium, fecha de acceso: marzo 22, 2025, https://medium.com/sonic8/ai-powered-audio-watermarking-protect-your-content-d4040ae29b61

- An early look at cryptographic watermarks for AI-generated content – The Cloudflare Blog, fecha de acceso: marzo 22, 2025, https://blog.cloudflare.com/an-early-look-at-cryptographic-watermarks-for-ai-generated-content/

- XAttnMark: Learning Robust Audio Watermarking with Cross-Attention – Yixin Liu, fecha de acceso: marzo 22, 2025, https://liuyixin-louis.github.io/xattnmark/

- [Literature Review] XAttnMark: Learning Robust Audio Watermarking with Cross-Attention, fecha de acceso: marzo 22, 2025, https://www.themoonlight.io/review/xattnmark-learning-robust-audio-watermarking-with-cross-attention

- Audio Watermarking: A Comprehensive Review – The Science and Information (SAI) Organization, fecha de acceso: marzo 22, 2025, https://thesai.org/Downloads/Volume15No5/Paper_141-Audio_Watermarking_A_Comprehensive_Review.pdf

- AudioMarkBench: Benchmarking Robustness of Audio Watermarking – arXiv, fecha de acceso: marzo 22, 2025, https://arxiv.org/html/2406.06979v1

- AudioMarkBench: Benchmarking Robustness of Audio Watermarking – NeurIPS, fecha de acceso: marzo 22, 2025, https://proceedings.neurips.cc/paper_files/paper/2024/hash/5d9b7775296a641a1913ab6b4425d5e8-Abstract-Datasets_and_Benchmarks_Track.html

- Detecting AI fingerprints: A guide to watermarking and beyond, fecha de acceso: marzo 22, 2025, https://www.brookings.edu/articles/detecting-ai-fingerprints-a-guide-to-watermarking-and-beyond/

- SoK: Watermarking for AI-Generated Content – arXiv, fecha de acceso: marzo 22, 2025, https://arxiv.org/html/2411.18479v2

- On the Reliability of Watermarks for Large Language Models – OpenReview, fecha de acceso: marzo 22, 2025, https://openreview.net/pdf/8346f872a9e6321321db39a32310048c025726d6.pdf

- Revisiting the Robustness of Watermarking to Paraphrasing Attacks – arXiv, fecha de acceso: marzo 22, 2025, https://arxiv.org/html/2411.05277v1

- Revisiting the Robustness of Watermarking to Paraphrasing Attacks – ACL Anthology, fecha de acceso: marzo 22, 2025, https://aclanthology.org/2024.emnlp-main.1005.pdf

- Provable Robust Watermarking for AI-Generated Text – OpenReview, fecha de acceso: marzo 22, 2025, https://openreview.net/forum?id=SsmT8aO45L

- The Case for and Against AI Watermarking | RAND, fecha de acceso: marzo 22, 2025, https://www.rand.org/pubs/commentary/2024/01/the-case-for-and-against-ai-watermarking.html

- Encouraging Academic Integrity – University Center for Teaching and Learning, fecha de acceso: marzo 22, 2025, https://teaching.pitt.edu/resources/encouraging-academic-integrity/

- AI detectors: An ethical minefield – Center for Innovative Teaching and Learning -, fecha de acceso: marzo 22, 2025, https://citl.news.niu.edu/2024/12/12/ai-detectors-an-ethical-minefield/

- What is False Positives and False Negatives in AI driven Inspections automation, fecha de acceso: marzo 22, 2025, https://intelgic.com/what-is-false-positives-and-false-negatives-in-ai-driven-quality-inspection

- The case against AI detectors | Office of Teaching, Learning, and Technology, fecha de acceso: marzo 22, 2025, https://teach.its.uiowa.edu/news/2024/09/case-against-ai-detectors

- I tested 10 AI content detectors – and these 3 correctly identified AI text every time | ZDNET, fecha de acceso: marzo 22, 2025, https://www.zdnet.com/article/i-tested-10-ai-content-detectors-and-these-3-correctly-identified-ai-text-every-time/

- How Reliable Are AI Content Detection Tools? : r/SEO – Reddit, fecha de acceso: marzo 22, 2025, https://www.reddit.com/r/SEO/comments/1g9c5o5/how_reliable_are_ai_content_detection_tools/

- How to Detect AI-Generated Content (10+ Proven Ways) – Fleksy, fecha de acceso: marzo 22, 2025, https://www.fleksy.com/blog/how-to-detect-ai-content/

- 4 Ways AI Content Detectors Work To Spot AI – Surfer SEO, fecha de acceso: marzo 22, 2025, https://surferseo.com/blog/how-do-ai-content-detectors-work/

- [P] AI Content Detector : r/MachineLearning – Reddit, fecha de acceso: marzo 22, 2025, https://www.reddit.com/r/MachineLearning/comments/10ofcis/p_ai_content_detector/

- 10 Actionable Tips To Avoid AI Detection In Writing – Surfer SEO, fecha de acceso: marzo 22, 2025, https://surferseo.com/blog/avoid-ai-detection/

- I’m reaching out to clarify YouTube’s monetization policy regarding content generated using AI – Google Help, fecha de acceso: marzo 22, 2025, https://support.google.com/youtube/thread/302925347/i-m-reaching-out-to-clarify-youtube-s-monetization-policy-regarding-content-generated-using-ai?hl=en

- Disclosing use of altered or synthetic content – Android – YouTube Help, fecha de acceso: marzo 22, 2025, https://support.google.com/youtube/answer/14328491?hl=en&co=GENIE.Platform%3DAndroid

- How TikTok launched new AI labeling policies to prevent misleading content and empower responsible creation – Partnership on AI, fecha de acceso: marzo 22, 2025, https://partnershiponai.org/tiktok-framework-case-study/

- X’s (Twitter) New Data Policy Sparks Controversy Over AI Training – Metricool, fecha de acceso: marzo 22, 2025, https://metricool.com/x-twitter-new-ai-training-policy-controversy/

- Elon Musk’s X Updates Privacy Policy to Allow AI Training on User Data – The Legal Wire, fecha de acceso: marzo 22, 2025, https://thelegalwire.ai/elon-musks-x-updates-privacy-policy-to-allow-ai-training-on-user-data/

- AI and Artists | Supporting artists’ rights as AI develops – DACS, fecha de acceso: marzo 22, 2025, https://www.dacs.org.uk/advocacy/ai-and-artists

- Copyright and Artificial Intelligence Consultation: What visual artists and rightsholders need to know – DACS, fecha de acceso: marzo 22, 2025, https://www.dacs.org.uk/news-events/copyright-and-artificial-intelligence-consultation-what-visual-artists-and-rightsholders-need-to-know

- NAEA Position Statement on Use of Artificial Intelligence (AI) and AI-generated Imagery in Visual Arts Education, fecha de acceso: marzo 22, 2025, https://www.arteducators.org/advocacy-policy/articles/1303-naea-position-statement-on-use-of-artificial-intelligence-ai-and-ai-generated-imagery-in-visual-arts-education

- AI applications in the visual arts – Arte es Ética, fecha de acceso: marzo 22, 2025, https://arteesetica.org/wp-content/uploads/2023/05/Position_Paper_EGAIR_EN.pdf

- Artificial Intelligence and Generative AI for Media & Journalism – LibGuides at University of North Carolina at Chapel Hill, fecha de acceso: marzo 22, 2025, https://guides.lib.unc.edu/generativeAI/ai-journalism

- Can journalism survive AI? – Brookings Institution, fecha de acceso: marzo 22, 2025, https://www.brookings.edu/articles/can-journalism-survive-ai/

- News/Media Alliance Urges US to Encourage Responsible AI Innovation by Protecting Intellectual Property Rights, fecha de acceso: marzo 22, 2025, https://www.newsmediaalliance.org/nma-ai-action-plan-comments/

- Artificial intelligence: journalism before algorithms – National Union of Journalists, fecha de acceso: marzo 22, 2025, https://www.nuj.org.uk/resource/artificial-intelligence.html

- The Case for Journalism on AI — EA Forum, fecha de acceso: marzo 22, 2025, https://forum.effectivealtruism.org/posts/bYrh5CMhmGDohjztD/the-case-for-journalism-on-ai

- The AI Revolution in Federal Proposal Writing: Ensuring Compliance and High-Quality Submissions – Unanet, fecha de acceso: marzo 22, 2025, https://unanet.com/proposal-ai/insights/the-ai-revolution-in-federal-proposal-writing-ensuring-compliance-and-high-quality-submissions

- Training the Next Generation of Government Proposal Writers: The AI Revolution – Unanet, fecha de acceso: marzo 22, 2025, https://unanet.com/proposal-ai/insights/training-the-next-generation-of-government-proposal-writers-the-ai-revolution

- How to use AI in Grant Writing, fecha de acceso: marzo 22, 2025, https://grantprofessionals.org/news/689531/How-to-use-AI-in-Grant-Writing.htm

How Medical Writing and Regulatory Affairs Professionals Can Embrace and Deploy Generative AI at Scale – Applied Clinical Trials, fecha de acceso: marzo 22, 2025, https://www.appliedclinicaltrialsonline.com/view/medical-writing-regulatory-affairs-professionals-embrace-deploy-generative-ai

Debe estar conectado para enviar un comentario.